W ciągu ostatnich kilku lat, jako zespół realizujący projekty AI w środowiskach enterprise, byliśmy wielokrotnie proszeni o konsultacje nowych inicjatyw związanych z automatyzacją opartą o sztuczną inteligencję.

Te rozmowy rzadko zaczynają się od teorii.

Zaczynają się od bardzo konkretnych ambicji i projektów takich jak:

zaprojektowanie agentów głosowych i konwersacyjnych AI głęboko zintegrowanych z systemami polisowymi, billingowymi i CRM — z pełną audytowalnością i bezpiecznymi ścieżkami eskalacji,

budowę wewnętrznych copilotów AI podłączonych do systemów takich jak ERP, CRM czy systemów zarządzania dokumentami,

zastępowanie wybranych funkcji SaaS lokalnie kontrolowanymi, domenowo dostosowanymi systemami LLM tam, gdzie uzasadnione jest przejęcie kontroli nad danymi, compliance i strukturą kosztową,

integracja AI z procesami compliance z zapewnieniem monitów, obserwowalności i gotowości regulacyjnej.

Technicznie większość tych projektów jest wykonalna.

Architektonicznie — można je zaprojektować.

Ale:

wykonalność to nie to samo co dopasowanie strategiczne.

I właśnie w tym miejscu wiele inicjatyw AI zaczyna się rozjeżdżać.

Iluzja „bezpiecznej AI” w korporacjach

W wielu organizacjach obserwujemy powtarzający się wzorzec decyzyjny.

Menadżerowie — często bardzo kompetentni — wybierają projekty AI, które wydają się bezpieczne:

automatyzacja jednego konkretnego procesu,

zastąpienie istniejącej funkcji SaaS własnym rozwiązaniem AI,

pilotaż na mniej krytycznym obszarze,

redukcja kosztów związana z personelem w jednym obszarze.

Psychologicznie takie podejście jest zrozumiałe.

Jest:

mierzalne,

ograniczone w zasięgu,

łatwe do przedstawienia zarządowi,

łatwe do komunikacji.

A jeśli projekt zawiedzie?

Łatwo jest powiedzieć:

„Model nie był jeszcze dojrzały.”

„Technologia AI zawiodła.”

„Wrócimy do tego za rok.”

Wina przechodzi na narzędzie — a nie na decyzję strategiczną. To jest paradoks. To, co wydaje się bezpieczne na poziomie inicjatywy, często jest strategicznie kruche.

Niedawne rewaluacje na rynku SaaS pokazały właśnie tę słabość: automatyzacja workflow, którą da się opisać słowami, jest pierwsza w kolejce do komodytyzacji .

Projekty AI w enterprise oparte na tej samej logice niosą te same ryzyka strukturalne.

Czy porażka jest akceptowalna?

Czy porażka jest dopuszczalna w projektach AI w korporacjach? Formalnie — nie, przecież żadna organizacja nie planuje porażki.

Ale unikanie ryzyka strukturalnego blokuje głęboką zmianę.

Jeśli organizacja:

unika głębokiej integracji,

unika decyzji architektonicznych,

nie wprowadza AI do operacyjnego rdzenia swoich procesów,

wtedy nigdy nie zrozumie, co działa, a co nie — i dlaczego.

W takim przypadku strategia AI organizacji jest kształtowana przez:

vendorów,

ewangelistów technologicznych,

marketing SaaS,

narracje konkurencji…

… które nie zawsze są najlepszymi źródłami decyzji.

Prawdziwym ryzykiem nie jest zatem sama porażka, ale outsourcing myślenia strategicznego.

Przed wyceną: najpierw kontekst

Dlatego rzadko od razu przechodzimy do wyceny projektu.

Zanim jakakolwiek inicjatywa AI trafi do pipeline’u wdrożeniowego, najpierw pytamy:

W jaki sposób firma naprawdę generuje wartość?

Gdzie są wąskie gardła operacyjne?

Gdzie pojawiają się obszary regulacyjne i compliance?

Czy AI ma przede wszystkim redukować koszty, czy ma stać się warstwą operacyjną?

Czy organizacja ma dojrzałość do długoterminowego utrzymania rozwiązania?

Bez tej analizy wdrożenie AI staje się reaktywne, nie strategiczne. A w środowisku enterprise, działania reaktywne rzadko prowadzą do trwałej przewagi.

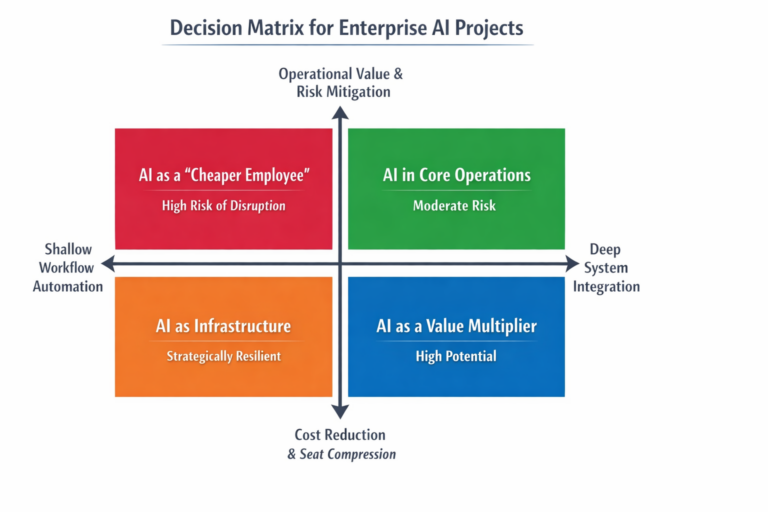

Matryca decyzyjna dla projektów AI w korporacjach

Na podstawie naszego doświadczenia oceniamy inicjatywy AI na dwóch zasadniczych płaszczyznach

Oś 1: Głębokość integracji

Płytka automatyzacja workflow

Głęboka integracja operacyjna i systemowa

Oś 2: Charakter wartości

Redukcja kosztów / kompresja użytkowników

Wzrost throughput / impuls przychodowy / ograniczenie ryzyka

AI jako „tańszy pracownik” (wysokie ryzyko strategiczne)

Jeśli projekt:

automatyzuje coś, co można opisać jednym promptem,

głównie redukuje liczbę osób wykonujących pracę,

wymaga minimalnej integracji,

ma niski koszt zmiany,

to jego przewaga jest krótkoterminowa.

To segment narażony na komodytyzację i szybką zmianę rynkową

AI osadzone w core operacjach (umiarkowane ryzyko)

Tutaj wchodzimy w klasyczny obszar enterprise:

integracja z CRM / ERP / systemami billingowymi,

governance i kontrola dostępu,

odpowiedzialność regulacyjna,

operacyjne uzależnienie.

Duże organizacje są z reguły konserwatywne przy zmianie głęboko osadzonych systemów — właśnie dlatego takie projekty mają większą odporność na postęp technologiczny – innymi słowy są:

ciężej zastępowalne u konkurencji przez przyszłe innowacji

AI jako infrastruktura (strategiczna odporność)

Najbardziej odporne inicjatywy nie zastępują pojedynczego procesu.

Tworzą one warstwę:

orkiestracji,

zarządzania,

obserwowalności,

bezpieczeństwa,

są w kluczowych procesach przepływów danych lub decyzji.

To jest dokładnie to, co robią przedsiębiorstwa, które nie konkurują z AI – multiplikują wartość dostarczaną swoim klientom przez jej wdrożenie.

AI jako multiplikator operacyjny (największy potencjał)

Najbardziej obiecujące inicjatywy to takie, w których AI:

zwiększa przepustowość modelu biznesowego,

poprawia jakość decyzji (np. scoring ryzyka czy detekcja fraudów),

wzmacnia wykorzystanie unikatowych zasobów (kompetencji, danych, ludzi),

redukuje ekspozycję regulacyjną.

To nie jest „AI zamiast ludzi”. To AI jako turbodoładowanie modelu biznesowego.

6 odpowiedzi, których szukamy przed wyceną projektu AI

Zanim przejdziemy do wyceny, zwykle pytamy:

Czy projekt automatyzuje coś, co można opisać, maksymalnie kilkoma promptami?

Czy jego głównym celem jest redukcja etatów?

Czy można go będzie zastąpić tańszym modelem w ciągu 12 miesięcy?

Czy jest głęboko zintegrowany z core systemami?

Czy działa w silnie regulowanym obszarze, gdzie zmiana systemu wiąże się z wysokim ryzykiem i kosztem?

Czy rosnąca adopcja AI wzmacnia jego wartość czy ją osłabia?

Jeśli odpowiedzi wskazują na płytką optymalizację kosztową bez głębokiego osadzenia, zazwyczaj rekomendujemy najpierw analizę strategiczną, a dopiero potem development.

Bo AI wdrożone bez kontekstu biznesowego może zaburzyć operacje zamiast je usprawnić.

Konkluzje

AI w środowisku korporacyjnym to nie rytonowe decyzje – AI to decyzja architektoniczna. Organizacje, które traktują AI jako narzędzie — optymalizują lokalnie.Organizacje, które traktują AI jako infrastrukturę — transformują strukturalnie.

Różnica między tymi podejściami zdecyduje, kto zbuduje trwałą przewagę, a kto jedynie krótkotrwałą automatyzację.